Здравствуйте, гость ( Вход | Регистрация )

28.06.2017 - 01:29 28.06.2017 - 01:29

Сообщение

#1

|

|

|

Группа: Пользователи Сообщений: 76 Регистрация: 27.04.2014 Пользователь №: 26375 |

Подскажите, пожалуйста, кто чем может)). Я делаю логистическую регрессию. Все предикторы биноминальные (0,1). Y-зависимая переменная(бинарная 0 - нет события(это хорошо), 1-есть событие(это плохо)). Дело в том, что нули к нулям, он мало мальски правильно соотносит, но 50% единиц(плохих) у него попадают к нулям(хорошим).Т.е. неверное определение. Как понять, почему так происходит и что сделать, чтобы улучшить классификацию, хотя бы до 85% точности?

Доп. инфо, я гуглила, и нашла метод Feature Selection и его реализацию в R Boruta. Выделила 6 предикторов, думала счастье рядом, сейчас построила модель, но не тут-то было, классификация такая же некачественная:(( Может что-то не то сделала?(( Что делать? (с)(Чернышевский Н.Г.)

Прикрепленные файлы

|

|

|

|

|

|

Ответов

28.06.2017 - 18:40 28.06.2017 - 18:40

Сообщение

#2

|

|

|

Группа: Пользователи Сообщений: 1091 Регистрация: 26.08.2010 Пользователь №: 22699 |

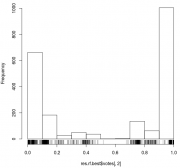

Подскажите, пожалуйста, кто чем может)). Я делаю логистическую регрессию. Все предикторы биноминальные (0,1). Y-зависимая переменная(бинарная 0 - нет события(это хорошо), 1-есть событие(это плохо)). Дело в том, что нули к нулям, он мало мальски правильно соотносит, но 50% единиц(плохих) у него попадают к нулям(хорошим).Т.е. неверное определение. Как понять, почему так происходит и что сделать, чтобы улучшить классификацию, хотя бы до 85% точности? Доп. инфо, я гуглила, и нашла метод Feature Selection и его реализацию в R Boruta. Выделила 6 предикторов , думала счастье рядом ,сейчас построила модель, но не тут-то было, классификация такая же некачественная:(( Может что-то не то сделала?(( Что делать? (с)(Чернышевский Н.Г.) ROC выглядит вот так как на атаче. Существуют только решения которые снабжены доверительным интервалом. Это видно из гистограмм распределения вероятности отнесения к конкретному классу. Ну и "пространство в котором проведены границы решения". Видно, что случаи которые действительно можно отделить "обкусывает края", можно сказать "за счет рандом эффекта". PS Можно только по результатам применения модели сказать что "если модель сказала 0, то весьма вероятно что действительно 0. А если модель сказала 1, то подбрось монетку и выбери случайный исход между 0 и 1". (!все это в случае одинаковой частоты исходов в генсовокупности! для конкретной частоты исходов в генсовокупности решения полезного вообще может не быть !) PPS Судя по всему никакого "более лучшего решения" тут не существует по принципиальным ограничениям. Сообщение отредактировал p2004r - 28.06.2017 - 19:09  |

|

|

|

|

Сообщений в этой теме

nastushka Логистическая регрессия в R 28.06.2017 - 01:29

nastushka Логистическая регрессия в R 28.06.2017 - 01:29

p2004r Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 08:07

p2004r Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 08:07

leo_biostat Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 08:34

leo_biostat Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 08:34

Олег Кравец Цитата(leo_biostat @ 28.06.2017 - 08... 28.06.2017 - 18:32

Олег Кравец Цитата(leo_biostat @ 28.06.2017 - 08... 28.06.2017 - 18:32

p2004r Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 19:46

p2004r Цитата(nastushka @ 28.06.2017 - 01:2... 28.06.2017 - 19:46

nastushka p2004r, суперски

leo_biostat, а можете как и p2004... 28.06.2017 - 20:39

nastushka p2004r, суперски

leo_biostat, а можете как и p2004... 28.06.2017 - 20:39

p2004r Цитата(nastushka @ 28.06.2017 - 20:3... 28.06.2017 - 23:14

p2004r Цитата(nastushka @ 28.06.2017 - 20:3... 28.06.2017 - 23:14

nastushka Что касается данных, то такие переменные как:

x3 x... 28.06.2017 - 21:23

nastushka Что касается данных, то такие переменные как:

x3 x... 28.06.2017 - 21:23

nokh Цитата(nastushka @ 29.06.2017 - 00:2... 28.06.2017 - 22:38

nokh Цитата(nastushka @ 29.06.2017 - 00:2... 28.06.2017 - 22:38

nastushka nokh, а как это сделать?)) Имеете ввиду регрессию ... 29.06.2017 - 11:46

nastushka nokh, а как это сделать?)) Имеете ввиду регрессию ... 29.06.2017 - 11:46

nastushka манагер одобрил удалять совпадающие наблюдения

Под... 29.06.2017 - 18:01

nastushka манагер одобрил удалять совпадающие наблюдения

Под... 29.06.2017 - 18:01

p2004r Цитата(nastushka @ 29.06.2017 - 18:0... 29.06.2017 - 19:49

p2004r Цитата(nastushka @ 29.06.2017 - 18:0... 29.06.2017 - 19:49

nastushka фух) я запарилась в ручную это перебирать)) p2004r... 30.06.2017 - 18:23

nastushka фух) я запарилась в ручную это перебирать)) p2004r... 30.06.2017 - 18:23

p2004r Цитата(nastushka @ 30.06.2017 - 18:2... 30.06.2017 - 23:53

p2004r Цитата(nastushka @ 30.06.2017 - 18:2... 30.06.2017 - 23:53

nastushka p2004r

смотрите, у меня родилась мысль

вот резуль... 2.07.2017 - 15:21

nastushka p2004r

смотрите, у меня родилась мысль

вот резуль... 2.07.2017 - 15:21

p2004r Цитата(nastushka @ 2.07.2017 - 15:21... 2.07.2017 - 15:42

p2004r Цитата(nastushka @ 2.07.2017 - 15:21... 2.07.2017 - 15:42

nastushka p2004r, у меня все получилось:)

Но возник такой в... 2.07.2017 - 20:54

nastushka p2004r, у меня все получилось:)

Но возник такой в... 2.07.2017 - 20:54

p2004r Цитата(nastushka @ 2.07.2017 - 20:54... 3.07.2017 - 22:13

p2004r Цитата(nastushka @ 2.07.2017 - 20:54... 3.07.2017 - 22:13

nastushka Терпение и труд, все перетрут) Сделала, но вот гуг... 3.07.2017 - 17:25

nastushka Терпение и труд, все перетрут) Сделала, но вот гуг... 3.07.2017 - 17:25

p2004r Цитата(nastushka @ 3.07.2017 - 17:25... 3.07.2017 - 22:10

p2004r Цитата(nastushka @ 3.07.2017 - 17:25... 3.07.2017 - 22:10

nastushka К сожалению вопросы есть

Кодstr(df)

... 4.07.2017 - 13:23

nastushka К сожалению вопросы есть

Кодstr(df)

... 4.07.2017 - 13:23

p2004r Цитата(nastushka @ 4.07.2017 - 13:23... 4.07.2017 - 20:18

p2004r Цитата(nastushka @ 4.07.2017 - 13:23... 4.07.2017 - 20:18

nastushka Y это isOneDay

поскольку мне сдавать нужно ,я пере... 4.07.2017 - 14:54

nastushka Y это isOneDay

поскольку мне сдавать нужно ,я пере... 4.07.2017 - 14:54

nastushka Да, Вы правы! p2004r, последний вопрос, интерп... 5.07.2017 - 17:51

nastushka Да, Вы правы! p2004r, последний вопрос, интерп... 5.07.2017 - 17:51

p2004r Цитата(nastushka @ 5.07.2017 - 17:51... 5.07.2017 - 21:33

p2004r Цитата(nastushka @ 5.07.2017 - 17:51... 5.07.2017 - 21:33

nastushka с RoC получилось разобраться. А как мне в отчете п... 6.07.2017 - 17:15

nastushka с RoC получилось разобраться. А как мне в отчете п... 6.07.2017 - 17:15

p2004r Цитата(nastushka @ 6.07.2017 - 17:15... 8.07.2017 - 23:06

p2004r Цитата(nastushka @ 6.07.2017 - 17:15... 8.07.2017 - 23:06

nastushka p2004r, подскажите

я рассчитала spec and sens

как ... 12.07.2017 - 15:08

nastushka p2004r, подскажите

я рассчитала spec and sens

как ... 12.07.2017 - 15:08

nastushka spec=0,06,sens=0.94 12.07.2017 - 15:12

nastushka spec=0,06,sens=0.94 12.07.2017 - 15:12

p2004r Цитата(nastushka @ 12.07.2017 - 15:1... 12.07.2017 - 18:49

p2004r Цитата(nastushka @ 12.07.2017 - 15:1... 12.07.2017 - 18:49

nastushka И такой вопросик

data(ROCR.simple)

threshold1 ... 12.07.2017 - 18:34

nastushka И такой вопросик

data(ROCR.simple)

threshold1 ... 12.07.2017 - 18:34

p2004r Цитата(nastushka @ 12.07.2017 - 18:3... 12.07.2017 - 18:43

p2004r Цитата(nastushka @ 12.07.2017 - 18:3... 12.07.2017 - 18:43

nokh Похоже мой ответ на письмо в личку не дошёл, дубли... 12.07.2017 - 18:35

nokh Похоже мой ответ на письмо в личку не дошёл, дубли... 12.07.2017 - 18:35

p2004r Цитата(nokh @ 12.07.2017 - 18:35) По... 12.07.2017 - 18:41

p2004r Цитата(nokh @ 12.07.2017 - 18:35) По... 12.07.2017 - 18:41

nastushka не-не он дошел, только что прочла:))) 12.07.2017 - 18:36

nastushka не-не он дошел, только что прочла:))) 12.07.2017 - 18:36

nastushka поняла 12.07.2017 - 18:56

nastushka поняла 12.07.2017 - 18:56

nastushka я просто так считала 12.07.2017 - 18:59

nastushka я просто так считала 12.07.2017 - 18:59

nastushka sensetivity=tp/(tp+fn) доля верных предсказаний п... 12.07.2017 - 19:00

nastushka sensetivity=tp/(tp+fn) доля верных предсказаний п... 12.07.2017 - 19:00

DrgLena spe=1-0,06=0,94 12.07.2017 - 19:24

DrgLena spe=1-0,06=0,94 12.07.2017 - 19:24

nastushka вы имеете ввиду, что 0,06 это чувствительность? 12.07.2017 - 19:46

nastushka вы имеете ввиду, что 0,06 это чувствительность? 12.07.2017 - 19:46

100$ Цитата(nastushka @ 12.07.2017 - 19:4... 12.07.2017 - 20:35

100$ Цитата(nastushka @ 12.07.2017 - 19:4... 12.07.2017 - 20:35

DrgLena Нет, вы привели таблицу из которой можно посчитат... 12.07.2017 - 20:37

DrgLena Нет, вы привели таблицу из которой можно посчитат... 12.07.2017 - 20:37

nastushka все поняла ошибку. 12.07.2017 - 20:45

nastushka все поняла ошибку. 12.07.2017 - 20:45

nastushka p2004r, здравствуйте, решила написать в своем же т... 5.08.2017 - 17:10

nastushka p2004r, здравствуйте, решила написать в своем же т... 5.08.2017 - 17:10

p2004r Цитата(nastushka @ 5.08.2017 - 17:10... 6.08.2017 - 14:29

p2004r Цитата(nastushka @ 5.08.2017 - 17:10... 6.08.2017 - 14:29

nastushka у меня AUc=0.55, в R считала, неужели мне никак мо... 6.08.2017 - 14:57

nastushka у меня AUc=0.55, в R считала, неужели мне никак мо... 6.08.2017 - 14:57

p2004r Цитата(nastushka @ 6.08.2017 - 14:57... 6.08.2017 - 16:39

p2004r Цитата(nastushka @ 6.08.2017 - 14:57... 6.08.2017 - 16:39

nastushka Кстати точно, попробую, прологарифмировать.

Подска... 6.08.2017 - 17:53

nastushka Кстати точно, попробую, прологарифмировать.

Подска... 6.08.2017 - 17:53

p2004r Цитата(nastushka @ 6.08.2017 - 17:53... 6.08.2017 - 20:19

p2004r Цитата(nastushka @ 6.08.2017 - 17:53... 6.08.2017 - 20:19

nastushka p2004r, подскажите, пожалуйста, а как мне нарисова... 8.08.2017 - 11:45

nastushka p2004r, подскажите, пожалуйста, а как мне нарисова... 8.08.2017 - 11:45

p2004r Цитата(nastushka @ 8.08.2017 - 11:45... 8.08.2017 - 19:08

p2004r Цитата(nastushka @ 8.08.2017 - 11:45... 8.08.2017 - 19:08

nastushka p2004r, Ваше мнение, как Вы считаете имеет ли мест... 9.08.2017 - 15:43

nastushka p2004r, Ваше мнение, как Вы считаете имеет ли мест... 9.08.2017 - 15:43

p2004r Цитата(nastushka @ 9.08.2017 - 15:43... 10.08.2017 - 00:16

p2004r Цитата(nastushka @ 9.08.2017 - 15:43... 10.08.2017 - 00:16

nastushka Т.е. вы считаете, что такую верификацию из двух ме... 10.08.2017 - 11:16

nastushka Т.е. вы считаете, что такую верификацию из двух ме... 10.08.2017 - 11:16

p2004r Цитата(nastushka @ 10.08.2017 - 11:1... 10.08.2017 - 16:50

p2004r Цитата(nastushka @ 10.08.2017 - 11:1... 10.08.2017 - 16:50

nastushka p2004r, я пробовала работать с тремя этими пакетам... 12.08.2017 - 13:35

nastushka p2004r, я пробовала работать с тремя этими пакетам... 12.08.2017 - 13:35

p2004r Цитата(nastushka @ 12.08.2017 - 13:3... 14.08.2017 - 16:27

p2004r Цитата(nastushka @ 12.08.2017 - 13:3... 14.08.2017 - 16:27  |